[SEO] robots.txt 정의 | 구글 or 네이버에서 유효성 검사하기

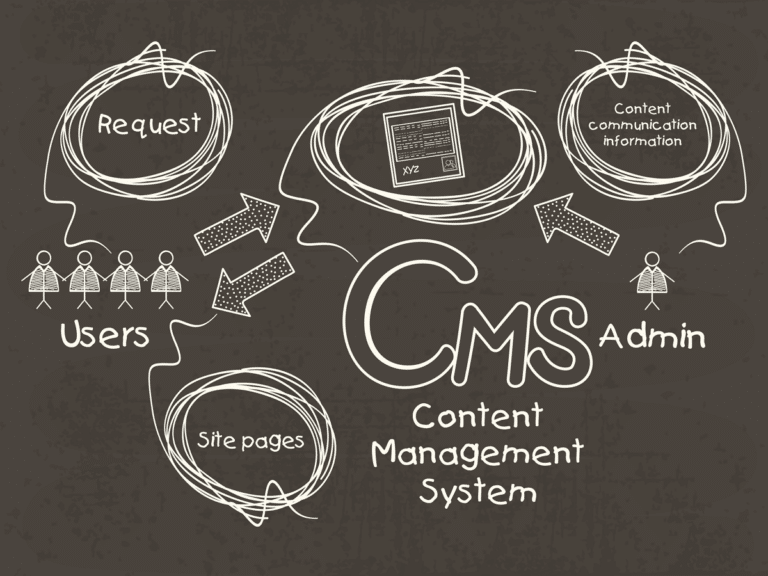

Robots.txt란 웹 마스터가 웹 로봇(보통 검색 엔진 로봇)에게 웹 사이트 페이지의 크롤링 방법을 지시하기 위한 텍스트 파일입니다. robots.txt 웹 사이트의 루트 파일에 위치하고 있어야 합니다. 이 파일은 로봇이 웹을 탐색하고 콘텐츠에 접근하며 해당 콘텐츠를 사용자에게 제공하는 방법을 제어하는 웹 표준인 로봇 배제 프로토콜(REP:robots exclusion protocol)의 일부입니다.

로봇 배제 프로토콜(REP)에 의해 모든 봇이 지침을 따르는 것은 아닙니다.

- 나쁜 봇은 지침을 따르지 않을 가능성이 높습니다.

- 이 규약은 자발적인 권고안이기 때문입니다.

- Robots.txt 파일은 한 개의 출처(도메인)를 다룹니다.

- 하나의 웹사이트에 여러 하위 도메인이 있는 경우, 각 하위 도메인은 자체 파일을 가져야 합니다.

Robots.txt 파일의 작동 원리

파일은 HTML 마크업 코드가 없는 텍스트 파일로, 웹 사이트의 다른 파일과 마찬가지로 웹 서버에서 호스팅됩니다. 웹 사이트 소유자는 이 파일을 사용하여 웹 로봇(검색 엔진 로봇 등)이 사이트의 페이지를 어떻게 크롤링하고 인덱싱해야 하는지 지시할 수 있습니다.

Robots txt 파일은 다음과 같은 방법으로 조회할 수 있습니다:

웹 브라우저 주소창에 https://www.yourdomain.com/robots.txt와 같이 웹 사이트의 전체 URL을 입력한 후 엔터를 누릅니다. 해당 URL로 요청을 보내면 웹 서버에서 파일의 내용을 응답으로 보내줍니다.

일반적으로 구글과 같은 주요 검색 엔진 로봇은 웹 사이트를 크롤링하기 전에 먼저 robots txt 파일을 확인하여 어떤 페이지를 방문하고 어떤 페이지를 무시해야 하는지 확인합니다.

요약하면, 웹 사이트 소유자가 웹 로봇에게 크롤링 동작을 제어하기 위해 사용하는 텍스트 파일로, 웹 서버에 호스팅되며 웹 로봇이 해당 사이트를 탐색할 때 이 파일의 지침을 확인합니다.

많이 사용하는 검색엔진 봇 사용자 에이전트

※ Google

Googlebot(일반)

Googlebot-Mobile

(모바일)

Googlebot-Image(이미지용)

Googlebot-News (뉴스용)

Googlebot-Video(동영상용)

Mediapartners-Google(애드센스)

※Bing

※ Bing

bingbot

MSNBot-Media(이미지 및 비디오용)

adidxbot(광고)

※DuckDuckGo

DuckDuckBot

※ Naver

Yeti

※ Apple

Applebot

※ Yandex

Yandex

※ Baidu

Baiduspider로봇.txt 파일 문법 예시

1. 모든 허용: 기본적인 파일 형식

와일드카드(*)는 모든 로봇을 의미합니다. Disallow는 비어있는 상태이기 때문에 모든 로봇이 방문할 수 있습니다. 가장 기본적인 상태입니다. robots txt가 와일드카드 및 정규식을 공식적으로 지원하지 않지만 대다수의 검색엔진은 이를 이해합니다.

User-agent: *

Disallow:

User-agent: *

Allow: /

Sitemap: https://www.example.com/my-sitemap.xml- User-agent: 크롤링 규칙을 설정할 크롤러를 지정합니다.

- Allow: 크롤링 허용 경로

- Disallow: 크롤링 제한할 경로

- Sitemap: 사이트맵이 위치한 경로 전체 URL의 위치를 Google, Bing와 같은 검색 엔진에 알릴 수 있습니다.

2. 워드프레스 robots.txt 기본 설정

wordpress 설치 시 기본 설정되는 기본 설정입니다. “워드프레스 robots txt 가 존재 하지 않습니다”와 같은 오류가 나타날 경우 FTP or cPanel 내의 파일 관리자를 이용해서 루트 폴더에 파일이 있는지 체크한 후 설정할 수 있습니다.

# 기본 설정 #

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://uknew.co/sitemap_index.xml유효성 검사

파일 수정 후 언제든지 구글 서치콘솔 robots txt 테스터에서 유효성 검사를 할 수 있습니다.

구글보다 네이버 서치어드바이저에서 사용하는 유효성 검사 툴이 개인적으로 더 편합니다.

구글의 가이드라인

구글의 robots 파일 소개 일부 내용 발췌

- 규칙은 일부 검색엔진에서만 지원될 수 있습니다.

robots txt 파일의 지침은 사이트에서의 크롤러 동작을 강제로 제어할 수 없습니다. 크롤러가 지침을 준수할지를 스스로 판단하게 됩니다. Googlebot 및 기타 잘 제작된 웹 크롤러는 robots txt 파일의 지침을 준수하지만 준수하지 않는 크롤러도 있습니다. 그러므로 웹 크롤러로부터 정보를 안전하게 보호하려면 비밀번호로 서버의 비공개 파일을 보호하는 등 다른 차단 방법을 사용하는 것이 더 좋습니다.- 크롤러마다 구문을 다르게 해석합니다.

잘 제작된 웹 크롤러는 robots txt 파일의 규칙을 따르지만, 크롤러마다 규칙을 다르게 해석할 수도 있습니다. 특정 지침을 이해하지 못하는 크롤러도 있으므로 다양한 웹 크롤러에 적용될 수 있는 적절한 구문을 알아야 합니다.

주의점

Yoast SEO와 RankMath 및 SEO 사이트에서 공통으로 체크한 사항으로, 2015년부터 구글 서치 콘솔에서 사이트 소유자에게 CCS 및 JS 파일을 차단하지 말라고 경고한 것입니다.

왜냐하면 CSS 및 자바스크립트 파일 차단 시 구글은 웹 사이트가 제대로 작동하는지 확인할 수 없기 때문입니다. 구글 봇이 웹 사이트의 정보를 파악하지 못해 검색 엔진 순위가 하락할 수 있습니다.